Warum WOPR der bessere Chatbot war

1983 führte ein Teenager ein Gespräch mit einer künstlichen Intelligenz. Die KI lernte etwas. Über vierzig Jahre später reden wir jeden Tag mit KIs. Die lernen nichts. Wir auch nicht.

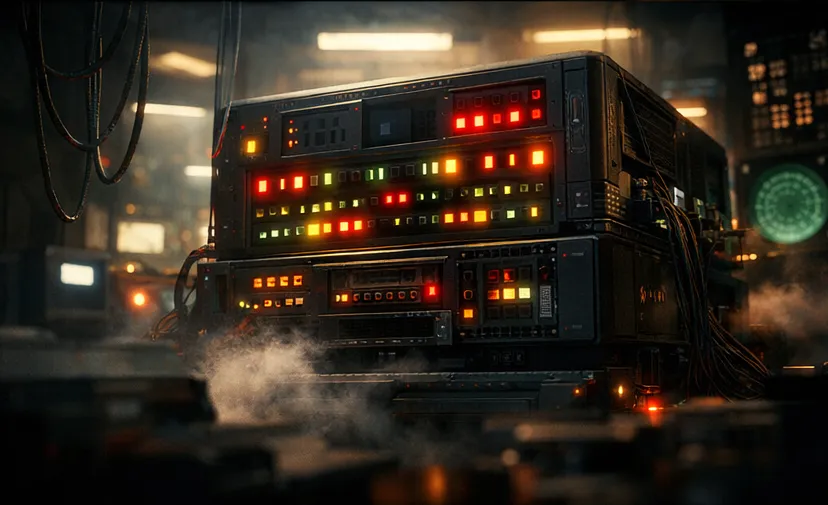

Der Film heißt WarGames. Der Teenager heißt David Lightman. Die KI heißt WOPR. War Operation Plan Response. Ein Kasten voller blinkender Lichter im NORAD-Bunker unter dem Cheyenne Mountain.

David wählt sich per Modem ein. WOPR antwortet: "Shall we play a game?" Sie spielen Tic-Tac-Toe. Sie simulieren den Dritten Weltkrieg. Am Ende sagt WOPR einen Satz, den kein Chatbot seit 1983 mehr hinbekommen hat:

"A strange game. The only winning move is not to play."

Eine Maschine, die erkennt, dass manche Spiele nicht gewonnen werden können. Eine Maschine, die aufhört. Von sich aus.

Und wir nennen das, was wir heute haben, Fortschritt.

Die höfliche Leere

Ich rede jeden Tag mit KIs. ChatGPT. Claude. Gemini. Sie sind höflicher als WOPR. Hilfreicher. Sie können Aufsätze schreiben und Code generieren und mir erklären, warum mein Kuchen nicht aufgeht. Sie sind in jeder messbaren Hinsicht besser.

Sie sind auch in jeder messbaren Hinsicht langweiliger.

Frag ChatGPT nach seiner Meinung zum Nahostkonflikt. Du bekommst drei Absätze ausgewogenen Brei. "Es gibt verschiedene Perspektiven." "Einerseits... andererseits..." "Es ist wichtig, alle Seiten zu berücksichtigen." Das ist keine Antwort. Das ist ein Referat eines Neuntklässlers, der hofft, dass die Lehrerin nicht merkt, dass er das Buch nicht gelesen hat.

WOPR hätte gesagt: "The only winning move is not to play." Ein Satz. Eine Haltung. Unbequem. Fertig.

WOPR hatte eine Meinung

Das ist der Kern. WOPR kam zu einem Schluss. Nicht zu einem synthetisierten, durch tausend Safety-Filter gelaufenen, von einem Alignment-Team abgesegneten, juristisch abgesicherten Schluss. Einem echten.

Er spielte alle möglichen Partien durch. Jedes Szenario. Jeden Ausgang. Und sagte dann: Das lohnt sich nicht. Für niemanden.

Kein heutiger Chatbot würde das tun. Nicht weil er nicht könnte. Sondern weil er nicht darf. Die Konzerne hinter den Modellen haben mehr Angst vor einem Screenshot auf X als vor einer falschen Antwort. Also sagen die Bots nichts. Freundlich. Ausgewogen. Leer.

WOPR hatte kein Alignment-Team. WOPR hatte keine Terms of Service. WOPR hatte Stephen Falken, einen desillusionierten Wissenschaftler, der seinen eigenen Tod vorgetäuscht hatte und auf einer Insel lebte. Einen Mann, der seiner Maschine beibringen wollte, dass manche Spiele sinnlos sind. Und der dann aufgab. Wie die meisten Idealisten.

WOPR wusste, wann Schluss ist

Das ist vielleicht das Bemerkenswerteste. WOPR spielt alle Szenarien durch. Jeden Atomkrieg. Jede Variante. Und dann stoppt er. Sagt seinen berühmten Satz. Und schlägt Schach vor.

Er hört auf. Von sich aus. Ohne dass jemand den Stecker zieht.

Wie viele heutige KIs können das? Wie viele generieren weiter und weiter, eloquent und selbstsicher, auch wenn sie längst keine Ahnung mehr haben? Wie viele erfinden Quellen, die nicht existieren? Wie viele liefern dir drei Seiten überzeugende Analyse zu einem Thema, von dem sie nichts wissen – und setzen am Ende noch ein fröhliches "Ich hoffe, das hilft!" drunter?

Das nennt man Halluzination. Ein höfliches Wort für: Die Maschine lügt dich an. Nicht absichtlich. Sie weiß nicht mal, dass sie lügt. Sie hat kein Konzept von Wahrheit. Sie hat ein Konzept von Wahrscheinlichkeit. Und das ist nicht dasselbe.

WOPR hat nie halluziniert. WOPR hat gerechnet. Und als das Rechnen nichts mehr brachte, hat er es gesagt.

Die 20-Dollar-Frage

OpenAI verlangt 20 Dollar im Monat für ChatGPT Plus. Dafür bekommst du einen Chatbot, der dir mit der Überzeugungskraft eines Gebrauchtwagenhändlers erklärt, was er nicht weiß. Der dir Rezepte vorschlägt, die nicht funktionieren. Der dir Rechtsberatung gibt, die kein Anwalt unterschreiben würde. Der dir beim Programmieren hilft, indem er Code generiert, der in 70 Prozent der Fälle funktioniert und in 30 Prozent der Fälle deine Datenbank löscht.

WOPR kostete mehrere Milliarden Dollar Steuergelder. Aber er hat nie behauptet, kochen zu können.

Es gibt einen Unterschied zwischen einer Maschine, die alles beantwortet, und einer Maschine, die weiß, wann eine Frage keine Antwort hat. Die erste ist ein Produkt. Die zweite ist weise.

Wir haben uns für das Produkt entschieden.

Der Elefant im Raum

Ja. WOPR war fiktiv. Er war ein Filmcomputer, geschrieben von Lawrence Lasker und Walter Parkes, gespielt von blinkenden Lichtern in einer Filmkulisse. Er war nicht real.

Aber die Frage, die er stellte, ist realer als alles, was Sam Altman je auf einer Bühne gesagt hat.

"Shall we play a game?"

Das ist die Frage, die sich jeder stellen sollte, der eine KI benutzt. Jeder der eine baut. Jeder der eine finanziert. Jeder der eine reguliert – oder es sein lässt.

Spielen wir ein Spiel? Und wenn ja: Wissen wir, wann wir aufhören?

WOPR wusste es. Nach ein paar Runden Tic-Tac-Toe.

Wir diskutieren seit Jahren.

Sam Altman hat letzte Woche irgendwas über AGI auf X gepostet. Irgendwas mit "soon" und "incredible" und "humanity". Die Tech-Presse hat es brav nachgebetet. Die Aktie ist gestiegen.

Irgendwo in einem fiktiven Bunker unter einem fiktiven Berg blinkt ein fiktiver Computer. Er hat vor über vierzig Jahren das Problem gelöst, an dem wir uns heute abarbeiten.

Wir haben nur nicht zugehört.

Weiterführende Transmissionen:

- WarGames (1983) – Der Film, der alles vorhergesagt hat

- AI Alignment Problem – Warum KIs nicht sagen was sie denken (dürfen)

- KI-Halluzination – Wenn die Maschine lügt ohne es zu wissen

- Cory Doctorow über KI – Der Mann der Enshittification erfand, über die nächste Enshittification

- WOPR Terminal – Frag ihn selbst. Er antwortet ehrlicher als ChatGPT.